Samenvatting

Grootschalige decodering maakt het mogelijk dat LLM's teksten drie keer sneller genereren, wat de toekomst van AI en zoektechnologie verandert.

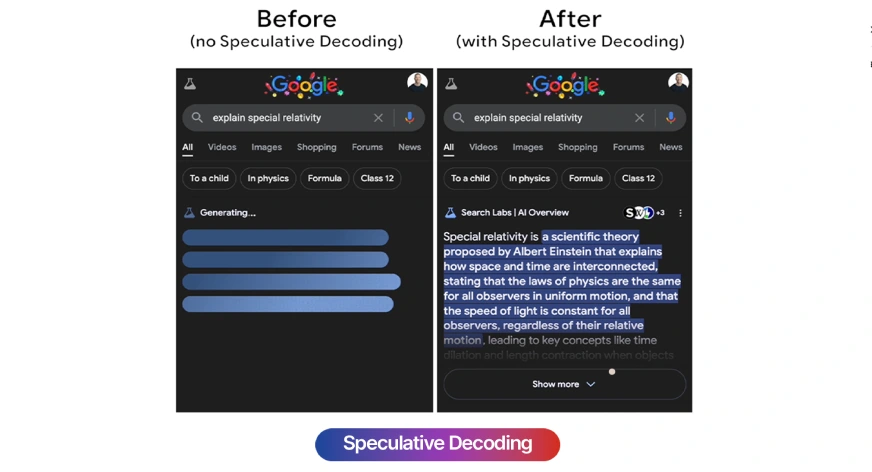

Snellere tekstgeneratie door speculatieve decodering

Recent onderzoek toont aan dat Language Models (LLM's) met behulp van speculatieve decodering hun responstijden significant kunnen versnellen. Deze technologie stelt modellen in staat om anticiperend teksten te genereren, waardoor de snelheid met wel 300% toeneemt in vergelijking met traditionele generatiemethoden.

Impact op de BI- en AI-markt

Deze ontwikkeling heeft grote implicaties voor de business intelligence-markt, waar snelheid en efficiëntie cruciaal zijn. Concurrenten kunnen de voordelen van snellere analyses benutten, wat leidt tot een verschuiving in hoe gegevens worden verwerkt en gepresenteerd. In een tijd waarin data-analyse steeds urgenter wordt, sluit deze trend aan bij de explosieve groei van AI-toepassingen in bedrijfsprocessen.

Actiepunt voor BI-professionals

BI-professionals moeten de implementatie en mogelijkheden van speculatieve decodering monitoren, aangezien deze technologie de manier waarop data wordt genoteerd en geïnterpreteerd kan revolutioneren. Het is essentieel om voorbereid te zijn op de verschuiving naar snellere en relevantere inzichten.

Verdiep je kennis

AI in Power BI — Copilot, Smart Narratives en meer

Ontdek alle AI-functies in Power BI: van Copilot en Smart Narratives tot anomaliedetectie en Q&A. Compleet overzicht met...

KennisbankChatGPT en BI — Hoe AI je data-analyse verandert

Ontdek hoe ChatGPT en generatieve AI de wereld van business intelligence veranderen. Van SQL en DAX genereren tot data-a...

KennisbankPredictive Analytics — Wat kan het voor jouw bedrijf?

Ontdek wat predictive analytics is, hoe het werkt en hoe je het inzet voor je bedrijf. Van de 4 niveaus van analytics to...